hive on spark 提交任务出现问题

背景:

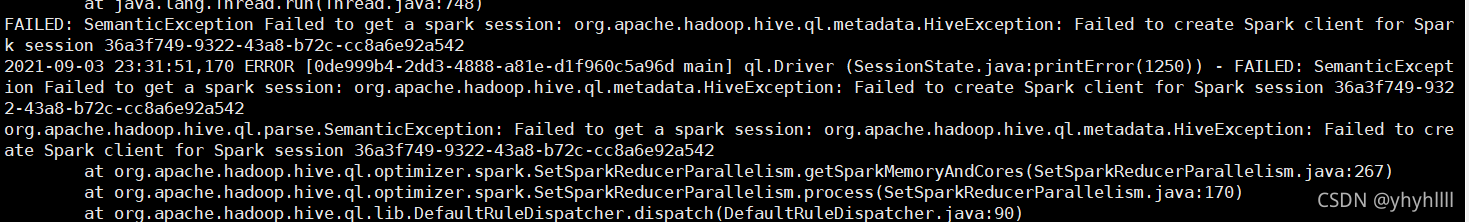

启动hive之前已经启动了hadoop、hiveserver2。而且已经进入到了hive的界面中,且创建好了表格和装载了数据,但是当进行sum操作的时候,报了下边的错误。spark session的问题?

org.apache.hadoop.hive.ql.parse.SemanticException: Failed to get a spark session: org.apache.hadoop.hive.ql.metadata.HiveException: Failed to create Spark client for Spark session 36a3f749-9322-43a8-b72c-cc8a6e92a542

检查之后把spark的配置文件hive-site.xml进行了修改,将超时时间扩大了,但是还是出现了一样的错误。

<property>

<name>hive.spark.client.connect.timeout</name>

<value>10000ms</value>

</property>

解决策略

不使用spark来跑hive的程序,将spark配置的参数全部注释掉,走mr的底层可以进行查询,聚合操作。

如果想使用spark来跑程序,可以试下卸载重装。如果你有好的解决方法,希望可以提出来哟~